标签:编码 14 Encoding Self 位置 pos https com 链接

博客配套视频链接: https://space.bilibili.com/383551518?spm_id_from=333.1007.0.0 b 站直接看 配套 github 链接:https://github.com/nickchen121/Pre-training-language-model 配套博客链接:https://www.cnblogs.com/nickchen121/p/15105048.html厚颜无耻的要个赞

Attention

优点:

- 解决了长序列依赖问题

- 可以并行

缺点:

-

开销变大了

-

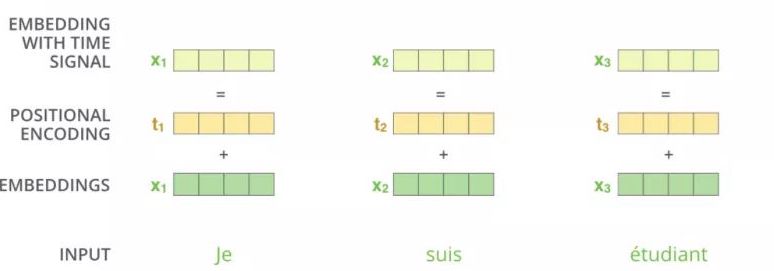

既然可以并行,也就是说,词与词之间不存在顺序关系(打乱一句话,这句话里的每个词的词向量依然不会变),即无位置关系(既然没有,我就加一个,通过位置编码的形式加)

位置编码的问题

为什么需要位置编码

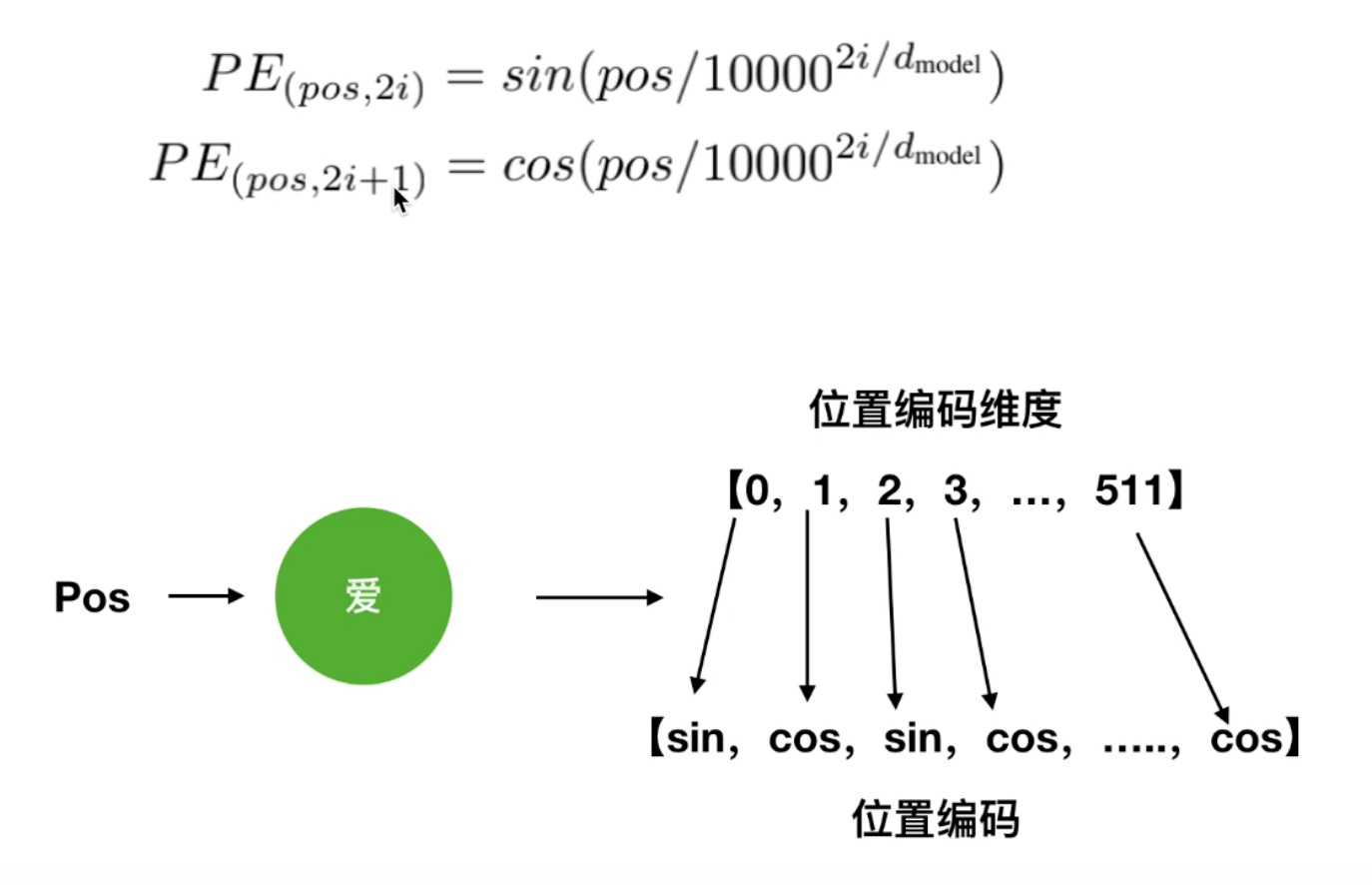

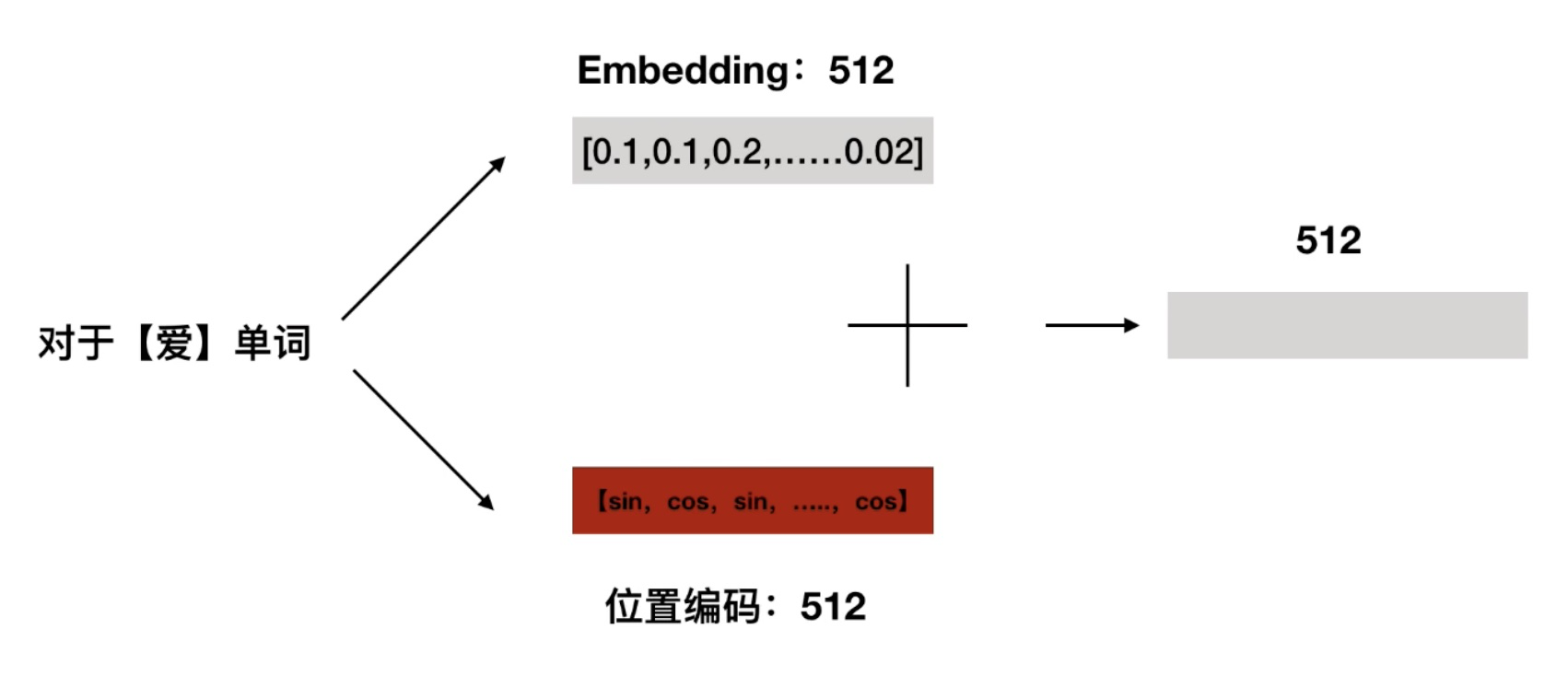

位置编码怎么做的

具体做法

做法 1

做法 2

为什么这么做有用

pos+K=5,我在计算第 5 个单词的位置编码的时候

pos=1,k=4

pos=2,k=3

标签:编码,14,Encoding,Self,位置,pos,https,com,链接 来源: https://www.cnblogs.com/nickchen121/p/16470736.html

本站声明: 1. iCode9 技术分享网(下文简称本站)提供的所有内容,仅供技术学习、探讨和分享; 2. 关于本站的所有留言、评论、转载及引用,纯属内容发起人的个人观点,与本站观点和立场无关; 3. 关于本站的所有言论和文字,纯属内容发起人的个人观点,与本站观点和立场无关; 4. 本站文章均是网友提供,不完全保证技术分享内容的完整性、准确性、时效性、风险性和版权归属;如您发现该文章侵犯了您的权益,可联系我们第一时间进行删除; 5. 本站为非盈利性的个人网站,所有内容不会用来进行牟利,也不会利用任何形式的广告来间接获益,纯粹是为了广大技术爱好者提供技术内容和技术思想的分享性交流网站。