标签:Flume hdfs 入门 job a1 k1 flume 数据 sinks

第2章 Flume入门

2.1 Flume安装部署

2.1.1 安装地址

-

Flume官网地址:http://flume.apache.org/

2.1.2 安装部署

-

将apache-flume-1.9.0-bin.tar.gz上传到linux的/opt/software目录下。

-

解压apache-flume-1.9.0-bin.tar.gz到/opt/module/目录下

[wolffy@hadoop102 software]$ tar -zxvf /opt/software/apache-flume-1.9.0-bin.tar.gz -C /opt/module/ -

修改apache-flume-1.9.0-bin的名称为flume-1.9.0

[wolffy@hadoop102 module]$ mv /opt/module/apache-flume-1.9.0-bin /opt/module/flume-1.9.0 -

将flume-1.9.0/lib文件夹下的guava-11.0.2.jar删除以兼容Hadoop 3.1.3

[wolffy@hadoop102 lib]$ rm /opt/module/flume-1.9.0/lib/guava-11.0.2.jar

2.2 Flume入门案例

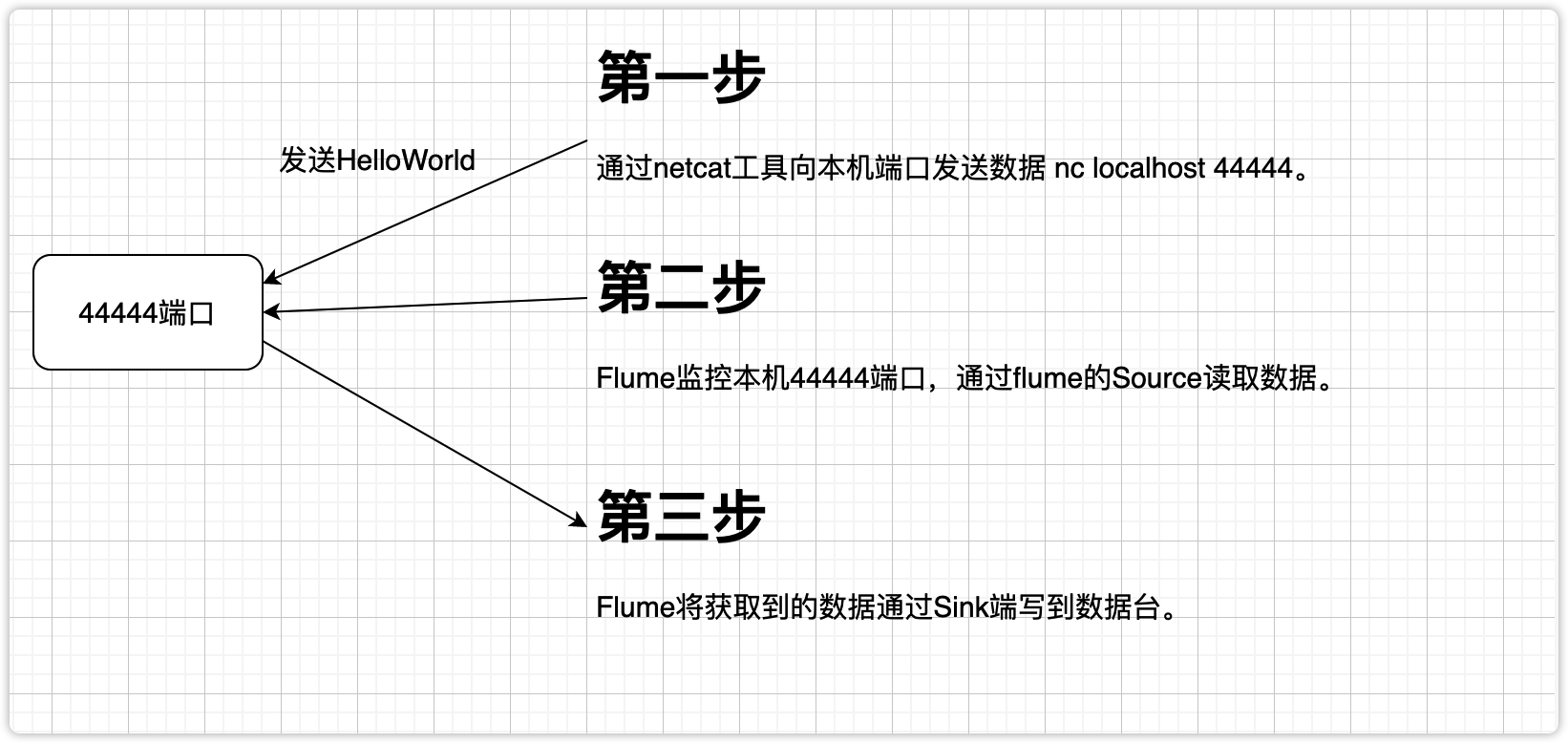

2.2.1 监控端口数据官方案例NetcatSource

1)案例需求:

使用Flume监听一个端口,收集该端口数据,并打印到控制台。

2)需求分析:

3)实现步骤:

(1)安装netcat工具

[wolffy@hadoop102 software]$ sudo yum install -y nc

(2)判断44444端口是否被占用

[wolffy@hadoop102 software]$ sudo netstat -nlp | grep 44444

(4)在flume目录下创建job文件夹并进入job文件夹。

[wolffy@hadoop102 flume-1.9.0]$ mkdir job

[wolffy@hadoop102 flume-1.9.0]$ cd job/

(5)在job文件夹下创建Flume Agent配置文件 netcat-flume-logger.conf。

[wolffy@hadoop102 job]$ vim netcat-flume-logger.conf

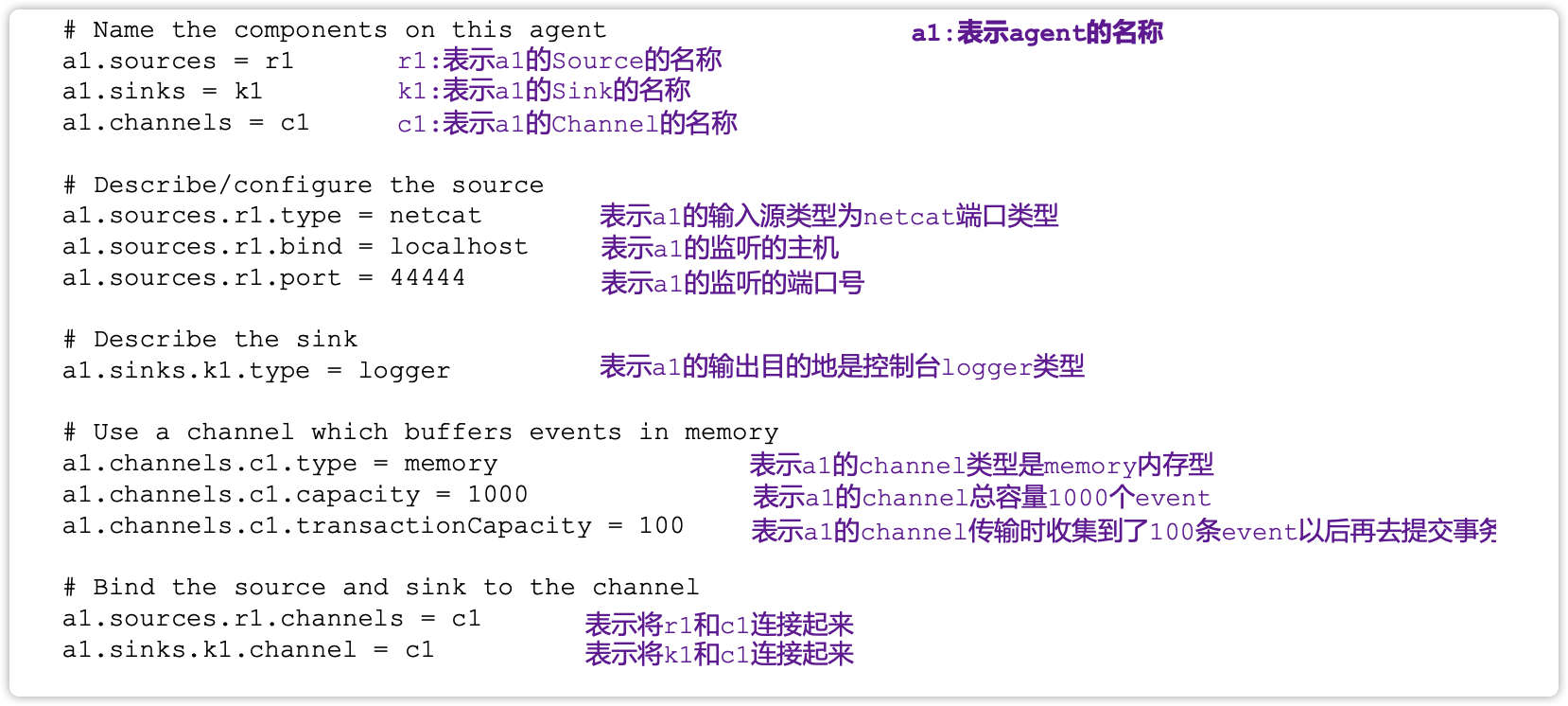

(6)在netcat-flume-logger.conf文件中添加如下内容。

添加内容如下:

# Name the components on this agent 给agent组件命名

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

# Describe the sink

a1.sinks.k1.type = logger

# Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

注:配置文件来源于官方手册

https://flume.apache.org/releases/content/1.9.0/FlumeUserGuide.html

配置文件解析

(7)先开启flume监听端口

第一种写法:

[wolffy@hadoop102 flume]$ bin/flume-ng agent --conf conf/ --name a1 --conf-file job/netcat-flume-logger.conf -Dflume.root.logger=INFO,console

第二种写法:

[wolffy@hadoop102 flume]$ bin/flume-ng agent -c conf/ -n a1 -f job/flume-netcat-logger.conf -Dflume.root.logger=INFO,console

参数说明:

- --conf/-c:表示配置文件存储在conf/目录

- --name/-n:表示给agent起名为a1

- --conf-file/-f:flume本次启动读取的配置文件是在job文件夹下的flume-telnet.conf文件。

- -Dflume.root.logger=INFO,console :-D表示flume运行时动态修改flume.root.logger参数属性值,并将控制台日志打印级别设置为INFO级别。日志级别包括:log、info、warn、error。

(8)使用netcat工具向本机的44444端口发送内容

[wolffy@hadoop102 ~]$ nc localhost 44444

helloWorld

(9)在Flume监听页面观察接收数据情况

2022-02-12 16:47:07,874 (SinkRunner-PollingRunner-DefaultSinkProcessor) [INFO - org.apache.flume.sink.LoggerSink.process(LoggerSink.java:95)] Event: { headers:{} body: 68 65 6C 6C 6F 57 6F 72 6C 64 helloWorld }

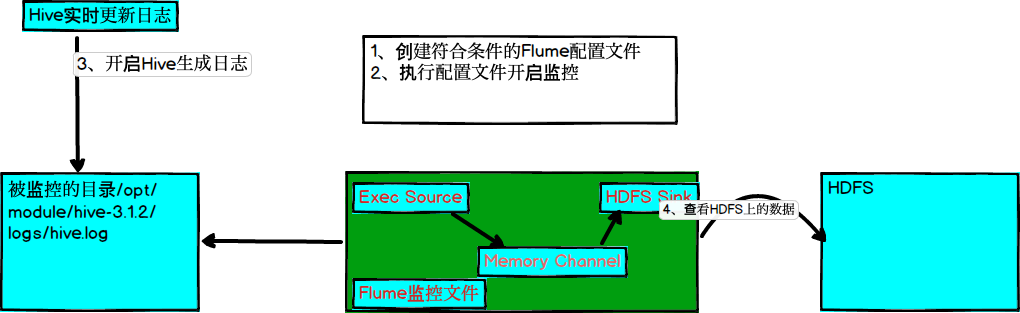

2.2.2 实时监控单个追加文件 ExecSource(命令)

1)案例需求:实时监控Hive.log日志,并上传到HDFS中.

2)需求分析:

当操作hive的时候,hive的日志hive.log是不断追加的。

3)实现步骤:

(1)Flume要想将数据输出到HDFS,依赖Hadoop相关jar包

检查/etc/profile.d/my_env.sh文件,确认Hadoop和Java环境变量配置正确

#JAVA_HOME

export JAVA_HOME=/opt/module/jdk1.8.0_212

export PATH=$PATH:$JAVA_HOME/bin

#HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-3.1.3

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

(2)创建 exec-flume-hdfs.conf文件

创建文件

[wolffy@hadoop102 job]$ vim exec-flume-hdfs.conf

注:要想读取Linux系统中的文件,就得按照Linux命令的规则执行命令。由于Hive日志在Linux系统中所以读取文件的类型选择:exec即execute执行的意思。表示执行Linux命令来读取文件。

添加如下内容

# Name

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# source 注意hive路径

a1.sources.r1.type = exec

a1.sources.r1.command = tail -F /opt/module/hive/logs/hive.log

# sink

a1.sinks.k1.type = hdfs

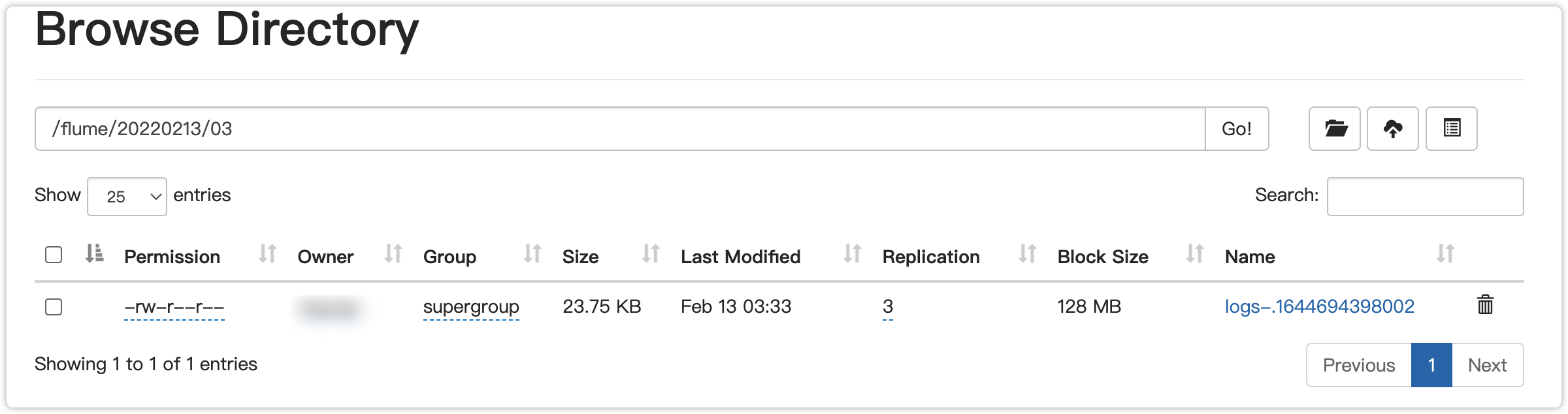

a1.sinks.k1.hdfs.path = hdfs://hadoop102:9820/flume/%Y%m%d/%H

#上传文件的前缀

a1.sinks.k1.hdfs.filePrefix = logs-

#是否按照时间滚动文件夹

a1.sinks.k1.hdfs.round = true

#多少时间单位创建一个新的文件夹

a1.sinks.k1.hdfs.roundValue = 1

#重新定义时间单位

a1.sinks.k1.hdfs.roundUnit = hour

#是否使用本地时间戳

a1.sinks.k1.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a1.sinks.k1.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a1.sinks.k1.hdfs.fileType = DataStream

#多久生成一个新的文件

a1.sinks.k1.hdfs.rollInterval = 30

#设置每个文件的滚动大小

a1.sinks.k1.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a1.sinks.k1.hdfs.rollCount = 0

# Channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# bind

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

注意:

对于所有与时间相关的转义序列,Event Header中必须存在以 “timestamp”的key(除非hdfs.useLocalTimeStamp设置为true,此方法会使用TimestampInterceptor自动添加timestamp)。

a1.sinks.k1.hdfs.useLocalTimeStamp = true

实时读取本地文件到HDFS

(3)运行Flume

[wolffy@hadoop102 flume-1.9.0]$ bin/flume-ng agent --conf conf/ --name a1 --conf-file job/exec-flume-hdfs.conf

(4)开启Hadoop和Hive并操作Hive产生日志

开启Hadoop集群和Hive

[wolffy@hadoop102 hive-3.1.2]$ sbin/start-dfs.sh

[wolffy@hadoop102 hive-3.1.2]$ sbin/start-yarn.sh

[wolffy@hadoop102 hive-3.1.2]$ hiveservices.sh start

[wolffy@hadoop102 hive-3.1.2]$ bin/hive

hive (default)>

(5)在HDFS上查看文件。

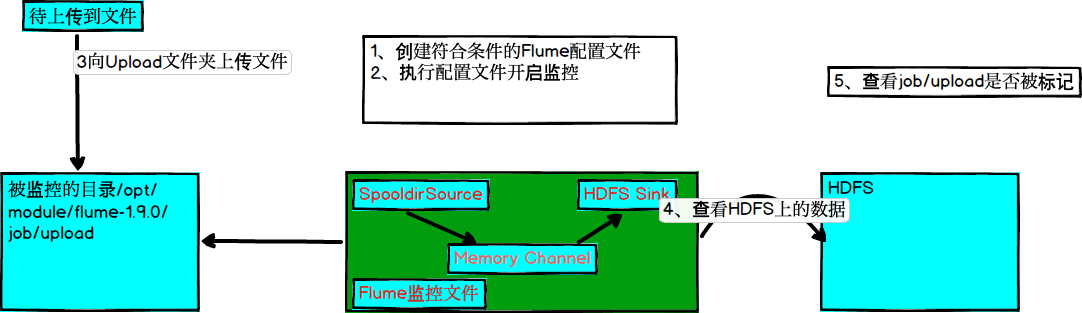

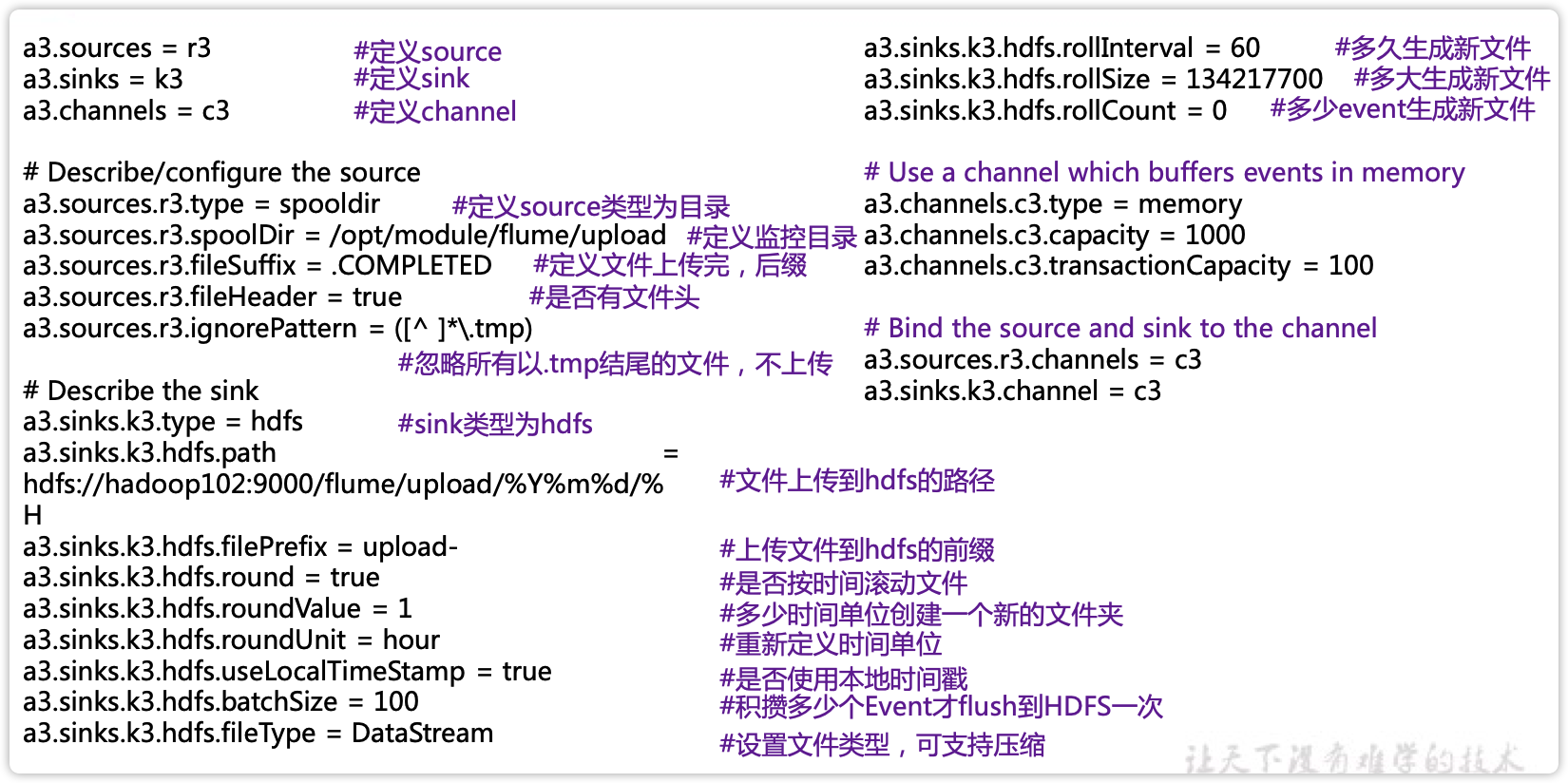

2.2.3 实时监控目录下多个新文件SpoolDirSource

1)案例需求:使用Flume监听整个目录的文件,并上传至HDFS

2)需求分析:

3)实现步骤:

(1)创建配置文件spooldir-flume-hdfs.conf

创建一个文件

[wolffy@hadoop102 job]$ vim spooldir-flume-hdfs.conf

添加如下内容

# Name

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# source

a1.sources.r1.type = spooldir

a1.sources.r1.spoolDir = /opt/module/flume-1.9.0/job/upload

a1.sources.r1.ignorePattern = ([^ ]*\.tmp)

# sink

a1.sinks.k1.type = hdfs

a1.sinks.k1.hdfs.path = hdfs://hadoop102:9820/flume/%Y%m%d/%H

#上传文件的前缀

a1.sinks.k1.hdfs.filePrefix = logs-

#是否按照时间滚动文件夹

a1.sinks.k1.hdfs.round = true

#多少时间单位创建一个新的文件夹

a1.sinks.k1.hdfs.roundValue = 1

#重新定义时间单位

a1.sinks.k1.hdfs.roundUnit = hour

#是否使用本地时间戳

a1.sinks.k1.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a1.sinks.k1.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a1.sinks.k1.hdfs.fileType = DataStream

#多久生成一个新的文件

a1.sinks.k1.hdfs.rollInterval = 30

#设置每个文件的滚动大小

a1.sinks.k1.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a1.sinks.k1.hdfs.rollCount = 0

# Channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# bind

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

(2)启动监控文件夹命令

[wolffy@hadoop102 flume]$ bin/flume-ng agent --conf conf/ --name a1 --conf-file job/spooldir-flume-hdfs.conf -Dflume.root.logger=INFO,console

说明:在使用Spooling Directory Source时,不要在监控目录中创建并持续修改文件;上传完成的文件会以.COMPLETED结尾;被监控文件夹每500毫秒扫描一次文件变动。

(3)向upload文件夹中添加文件

在/opt/module/flume-1.9.0/job/目录下创建upload文件夹

[wolffy@hadoop102 job]$ mkdir upload

向upload文件夹中添加文件

[wolffy@hadoop102 job]$ touch a.txt

[wolffy@hadoop102 job]$ touch b.tmp

[wolffy@hadoop102 job]$ mv a.txt b.txt ./upload/

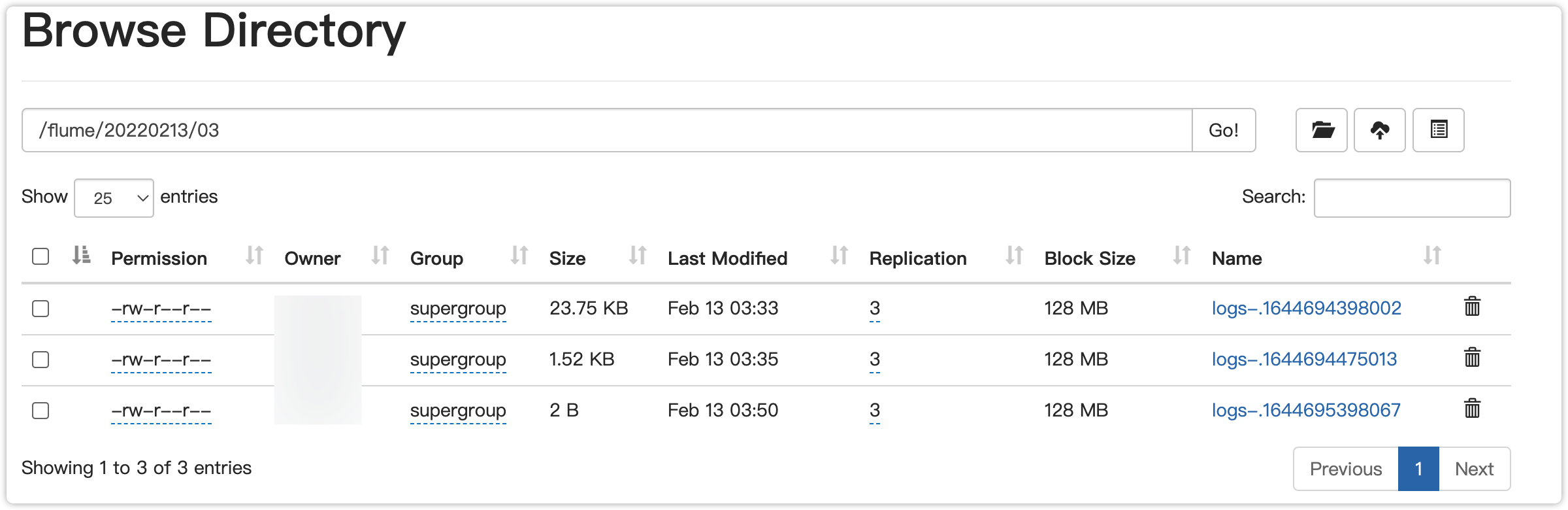

(4)查看HDFS上的数据

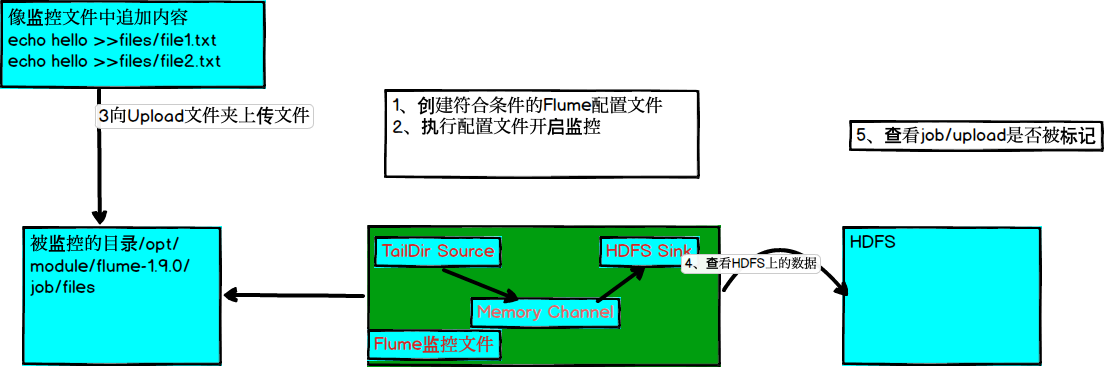

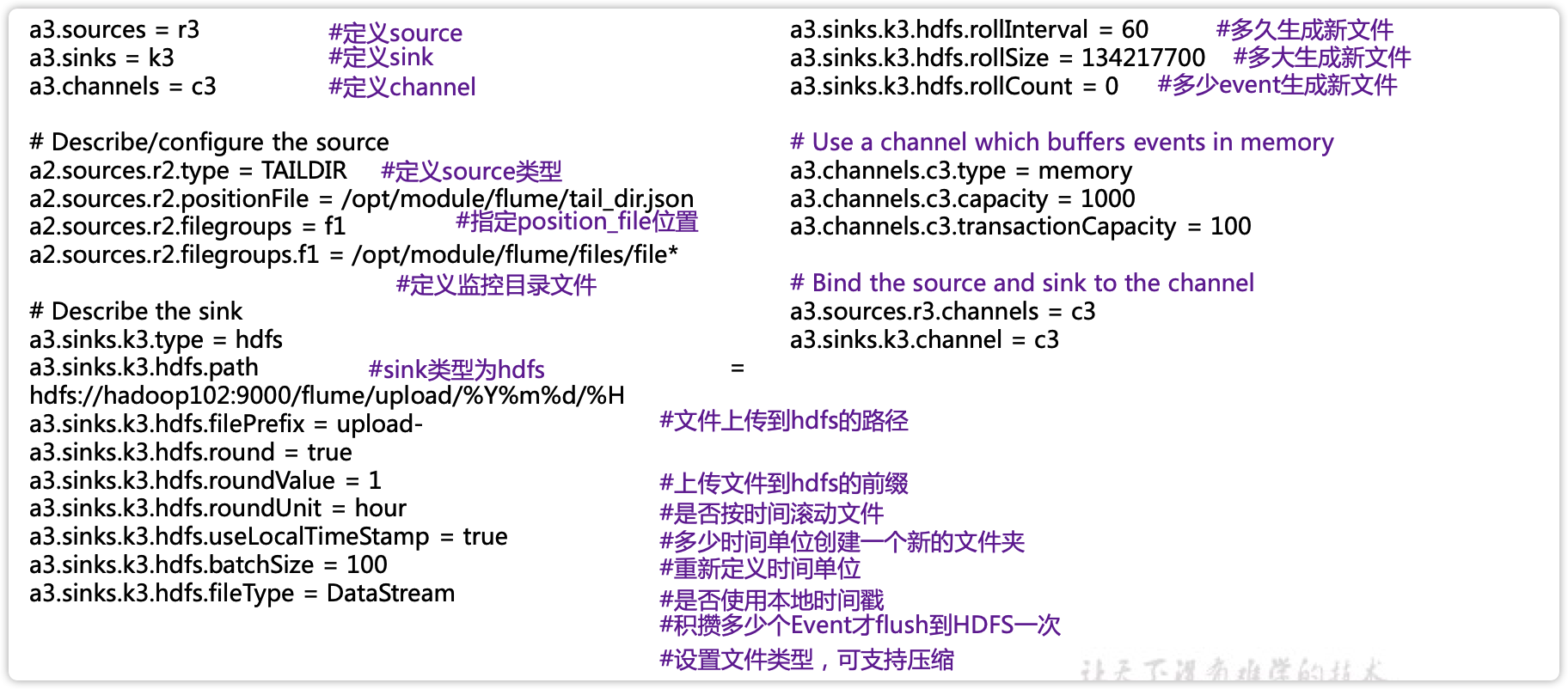

2.2.4 实时监控目录下的多个追加文件TailDirSource

Exec source适用于监控一个实时追加的文件,不能实现断点续传;Spooldir Source适合用于同步新文件,但不适合对实时追加日志的文件进行监听并同步;而Taildir Source适合用于监听多个实时追加的文件,并且能够实现断点续传。

1)案例需求:使用Flume监听整个目录的实时追加文件,并上传至HDFS

2)需求分析:

3)实现步骤:

(1)创建配置文件 job/taildir-flume-hdfs.conf

创建一个文件

[wolffy@hadoop102 job]$ vim taildir-flume-hdfs.conf

添加如下内容

# Name

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# source

a1.sources.r1.type = TAILDIR

a1.sources.r1.positionFile = /opt/module/flume-1.9.0/job/position/position.json

a1.sources.r1.filegroups = f1

a1.sources.r1.filegroups.f1 = /opt/module/flume-1.9.0/job/files/.*file.*

#a1.sources.r1.filegroups.f1 = /opt/module/flume-1.9.0/job/files/file1.txt

#a1.sources.r1.filegroups.f2 = /opt/module/flume-1.9.0/job/files/file2.txt

#a1.sources.r1.filegroups.f3 = /opt/module/flume-1.9.0/job/files/file3.txt

# sink

a1.sinks.k1.type = hdfs

a1.sinks.k1.hdfs.path = hdfs://hadoop102:9820/flume/%Y%m%d/%H

#上传文件的前缀

a1.sinks.k1.hdfs.filePrefix = logs-

#是否按照时间滚动文件夹

a1.sinks.k1.hdfs.round = true

#多少时间单位创建一个新的文件夹

a1.sinks.k1.hdfs.roundValue = 1

#重新定义时间单位

a1.sinks.k1.hdfs.roundUnit = hour

#是否使用本地时间戳

a1.sinks.k1.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a1.sinks.k1.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a1.sinks.k1.hdfs.fileType = DataStream

#多久生成一个新的文件

a1.sinks.k1.hdfs.rollInterval = 30

#设置每个文件的滚动大小

a1.sinks.k1.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a1.sinks.k1.hdfs.rollCount = 0

# Channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# bind

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

(2)启动监控文件夹命令

[wolffy@hadoop102 flume-1.9.0]$ bin/flume-ng agent --conf conf/ --name a1 --conf-file job/taildir-flume-hdfs.conf -Dflume.root.logger=INFO,console

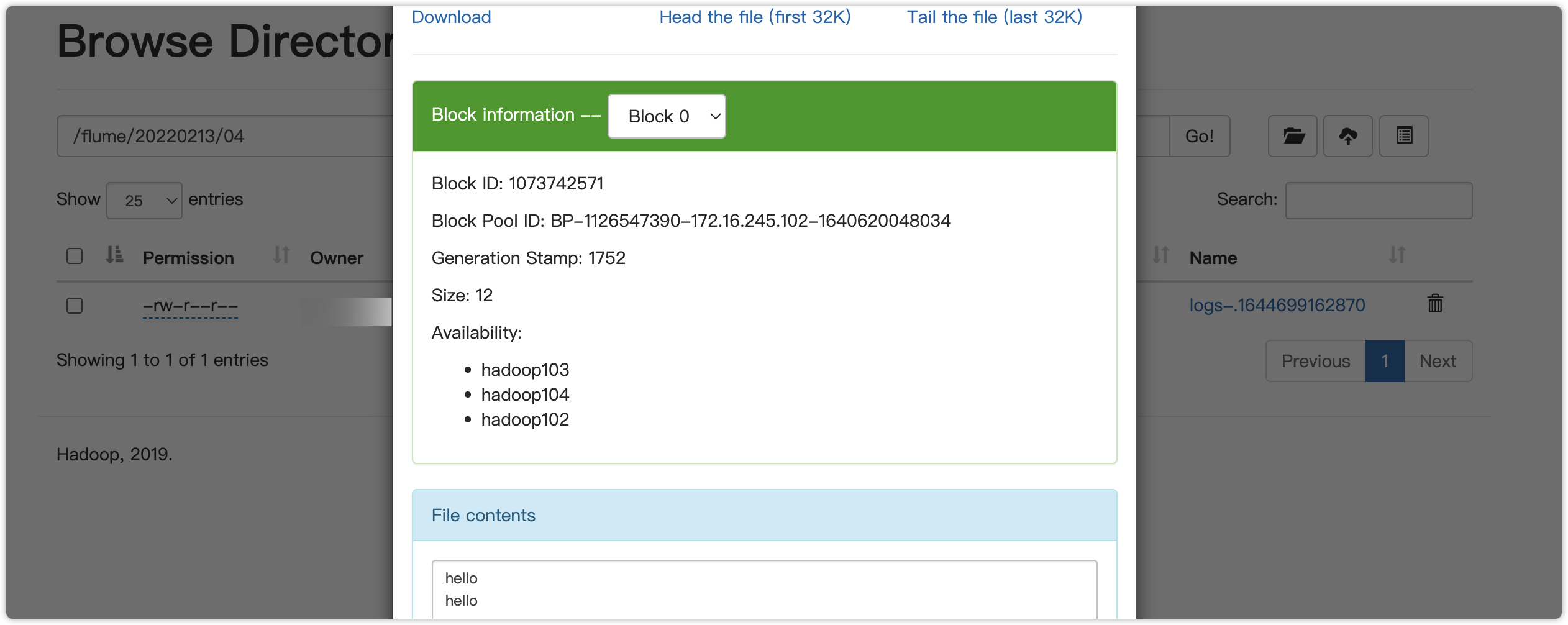

(3)向files文件夹中追加内容

在/opt/module/flume-1.9.0/job目录下创建files文件夹

[wolffy@hadoop102 job]$ mkdir files

向upload文件夹中添加文件

[wolffy@hadoop102 files]$ echo hello >> file1.txt

[wolffy@hadoop102 files]$ echo hello >> file2.txt

(4)查看HDFS上的数据

Taildir说明:

Taildir Source维护了一个json格式的position File,其会定期的往position File中更新每个文件读取到的最新的位置,因此能够实现断点续传。Position File的格式如下:

[{"inode":543572,"pos":12,"file":"/opt/module/flume-1.9.0/job/files/file3.txt"},{"inode":543573,"pos":18,"file":"/opt/module/flume-1.9.0/job/files/file2.txt"},{"inode":543574,"pos":46,"file":"/opt/module/flume-1.9.0/job/files/file1.txt"}]

注:Linux中储存文件元数据的区域就叫做inode,每个inode都有一个号码,操作系统用inode号码来识别不同的文件,Unix/Linux系统内部不使用文件名,而使用inode号码来识别文件。

IT学习网站

Spring Cloud Alibaba学习资源推荐

Spring Cloud Alibaba 微服务架构实战

链接: https://pan.baidu.com/s/1nJpfbjPyf3n339INybjOQQ?pwd=8t11 提取码: 8t11

--来自百度网盘超级会员v4的分享

失效加V:x923713

标签:Flume,hdfs,入门,job,a1,k1,flume,数据,sinks 来源: https://www.cnblogs.com/niuniu2022/p/16350386.html

本站声明: 1. iCode9 技术分享网(下文简称本站)提供的所有内容,仅供技术学习、探讨和分享; 2. 关于本站的所有留言、评论、转载及引用,纯属内容发起人的个人观点,与本站观点和立场无关; 3. 关于本站的所有言论和文字,纯属内容发起人的个人观点,与本站观点和立场无关; 4. 本站文章均是网友提供,不完全保证技术分享内容的完整性、准确性、时效性、风险性和版权归属;如您发现该文章侵犯了您的权益,可联系我们第一时间进行删除; 5. 本站为非盈利性的个人网站,所有内容不会用来进行牟利,也不会利用任何形式的广告来间接获益,纯粹是为了广大技术爱好者提供技术内容和技术思想的分享性交流网站。